ChatGPT è il buco sulla privacy che blocca l'AI

Il questi ultimi mesi che ChatGPT-3 sia diventato uno degli strumenti più usati al mondo non c’è dubbio lo testimonia il miliardo di visualizzazioni registrato a Febbraio 2023. Il questi ultimi giorni si è parlato molto della AI di OpenAI visto che il garante della privacy ha limitato l’uso dell’intelligenza artificiale in Italia.

La polemica esplosa, negli ultimi giorni, sui social in merito al blocco di ChatGPT da parte del garante della privacy non è un voler limitare l’uso dell’intelligenza artificiale ma riguarda la violazione di alcune regole fondamentali del GDPR non a caso anche Germania,Francia ed Irlanda stanno valutando provvedimenti smili ma facciamo un passo indietro per comprendere meglio la situazione.

Il giorno 30 marzo 2023 con il provvedimento n. 112 l’Autorità Garante per la Protezione dei Dati Personali ha richiesto ad OpenAI di limitare il trattamento dei dati personali nei confronti degli utenti italiani. Quindi l’utilizzo di ChatGPT non viene bloccato in modo diretto ma è una conseguenza dovuta alla violazione del GDPR, tant’è che la società ha annunciato una politica di rimborsi per tutti coloro che avevano acquistato un abbonamento a ChatGPT Plus. Tale scelta non mette l’Italia in una posizione di limitazione di sviluppo/diffusione dei sistemi di intelligenza artificiale ma accende un riflettore importante sull’etica dietro il funzionamento di questi sistemi.

Le motivazioni del Blocco

Il provvedimento, adottato in via d’urgenza, elenca in modo chiaro è sintetico le motivazioni dietro la scelta. I punti particolarmenti interessanti sono:

- Assenza dell’informativa agli utenti ed interessati;

- Assenza di base giuridica idonea alla raccolta dei dati e al loro trattamento per scopo di addestramento degli algoritmi sottesi al funzionamento di ChatGPT;

- Trattamento inesatto perchè le informazioni che fornisce ChatGPT non sono sempre corrispondenti al dato reale;

- Assenza di un controllo o di filtri per i minori di 13 anni;

Chi è “l’interessato” per ChatGPT?

Per rispondere a questa domanda bisogna leggere l’art. 4 del GDPR, l’interessato è la persona fisica alla quale si riferiscono i dati personali: ad esempio, nell’ambito di un servizio di video on demand, l’interessato è l’abbonato al servizio stesso, i cui dati vengono trattati vuoi per l’utilizzo del servizio, vuoi per profilarne il comportamento, proponendogli contenuti che possano soddisfare i suoi gusti o per il miglioramento della qualità del servizio stesso.

All’interno di tale informativa devono anche essere indicate le categorie di dati personali trattate, le finalità del trattamento e le sue condizioni di liceità: ritornando all’esempio precedente se i dati sono trattati per la fruizione del servizio (e, quindi, in questo caso la condizione di liceità è l’esecuzione del contratto) o per profilarlo (la norma vorrebbe che questa attività sia condizionata al consenso dell’utente)

La risposta alla domanda di partenza sembrerebbe essere banale Chi è l’interessato per ChatGPT? l’utente che usa il servizio in realtà per tutti i sistemi ML e IA tutti siamo potenzialmente interessati. L’esempio più semplice è l’immagine di Papa Francesco con un bomber bianco oversize che è diventata virale negli scorsi giorni di sicuro il Papa non ha dato il suo consenso all’AI per l’uso della sua immagine (né all’utente che ha scritto il prompt che l’ha generata, anche se si tratta di una figura pubblica), né presumibilmente è iscritto al servizio, eppure quell’immagine è stata creata ed ha fatto il giro del web.

Tanti utenti hanno usato ChatGPT come un amico virtuale, sostituendolo al supporto psicologico di uno specialista, in questo caso OpenAi viene a conoscenza di informazioni personali che vengono utilizzati per generare le risposte testuali nella chat, ma anche per continuare ad allenare l’algoritmo che la fa funzionare.

Insomma di esempi di informazioni che ChatGPT apprende mentre gli utenti lo usano c’è ne sono tanti proprio per questo è chiaro che OpenAI deve chiarire come queste informazioni vengano usate per una questione di trasparenza nei confronti dei suoi utenti stessi.

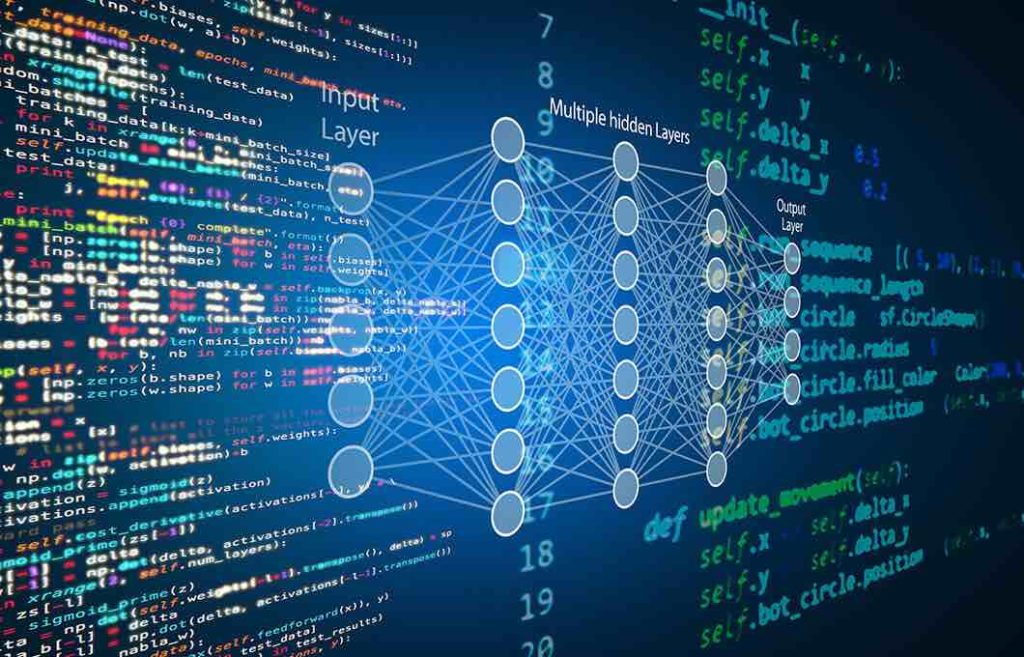

L’addestramento di ChatGPT

A complicare ulteriormente la questione c’è anche il tema dell’addestramento dell’algoritmo alla base di ChatGPT: è noto che le IA sono addestrate partendo da fonti pubbliche, ma non è detto che queste informazioni siano esatte ne che le persone che le avevano fornite ora non abbiano ritirato il consenso. Inoltre OpenAI ha pure dichiarato di aver attinto a Wikipedia per quanto l’enciclopedia libera consente la riproduzione dei propri contenuti su altre pagine o media, ChatGPT li usa per migliorare se stesso, rielaborando per fornire il proprio servizio. Insomma un uso tutt’altro che copyright-friendly.

Informazioni errate che valgono una limitazione

Come dichiarato da OpenAI, ChatGPT a volte sbaglia, restituendo informazioni sbagliate: ora dato che l’IA tratta i dati degli interessati potrebbe trattarli erroneamente, restituendo informazioni inesatte: ciò viola il principio di esattezza dei dati personali, previsto dal GDPR.

Questo si traduce in una distorsione dell’identità della persona. Di fatto, ChatGPT percepisce e identifica chiunque fra noi in un modo del tutto estraneo alla realtà questo perché il servizio non è intelligente nel senso umano ed umanistico del termine e non è in grado di discernere di chi stanno parlando e, soprattutto, a chi si stanno rivolgendo. Quando si parla di AI bisogna ricordarsi sempre che la predizione non è ragionamento.

ChatGPT integrato in Windows, Bing e Microsoft 365

Microsoft ha investito ingenti capitali per integrare ChatGPT all’interno di Bing, Windows e Microsoft 365. Il programma beta è gia partito per un gruppo di utenti selezionati, l’obbiettivo è di usare l’IA per migliorare le ricerche, le funzioni di sistema e semplificare il lavoro d’ufficio. Al momento della stesura di questo articolo ne Microsoft ne OpenAI si sono ancora espresse in merito all’integrazione dell’AI in questi servizi ma, dovranno essere adottate anche in questo caso misure tali da permettere all’interessato di dimostrare la propria età e, soprattutto, di essere messo in grado di comprendere quali suoi dati personali saranno trattati.

Limitare il trattamento non equivale al blocco del servizio!

L’opinione pubblica si è scagliata pesantemente contro la scelta del garante visto che ChatGPT al momento è inaccessibile in Italia. Credo si fondamentale fare chiarezza su questo punto visto che la limitazione al trattamento dei dati non equivale al blocco del servizio né all’inizio di una nuova era di oscurantismo verso i servizi di AI. La scelta di bloccare ChatGPT è stata di OpenAI stessa per impedire l’uso della piattaforma da parte dei minori.

Il rispetto della legge e quello delle libertà delle persone sono due aspetti fondamentali anche a costo di fermare lo sviluppo per qualche mese per adeguare il tutto alle normative. Sia per OpenAI che Microsoft, in qualità di investitore, conviene risolvere tali problematiche dato che anche altre autorità europee stanno valutanto provvedimenti smili: in tal caso, le conseguenze dal punto di vista finanziario potrebbero essere più gravi, ma i cittadini europei sarebbero molto più tutelati.

Conclusioni

Che ChatGPT sia la prima intelligenza artificiale generativa ad essere attenzionata da parte del garante, la cui intenzione è chiaramente quella di difendere la privacy di ciascuno di noi, sorvegliando sulla corretta applicazione del GDPR è una notizia positiva per la nostra sicurezza visto che il servizio di OpenAI viola effettivamente alcuni precetti del Regolamento.

L’argomento AI è comunque sotto i riflettori da parte dell’intera comunità mondiale, vedi la recente lettera di Elon Musk, Steve Wozniak e l’Unione Europea, che è in procinto di approvare l’Ai Act.

La questione è molto delicata perchè da un lato c’è la libertà di sviluppo di queste nuove tecnologie dall’altro deve essere tenuto al centro di tutto l’essere umano, proteggendo la sua identità, i suoi diritti e la sua libertà.